관련 머신러닝 방법 복습

이 섹션에서는 양자 머신러닝의 워크플로를 더 잘 이해하는 데 도움이 되는 고전 머신러닝의 핵심 용어와 방법을 복습합니다. 먼저 일반적인 용어를 소개한 다음, 두 가지 유형의 머신러닝인 커널 방법(특히 서포트 벡터 머신의 맥락에서)과 신경망을 심층적으로 살펴보겠습니다. 이러한 방법들 사이에는 분명히 연관성이 있지만, 여기와 이후 강의에서 다루는 양자 워크플로의 차이로 인해 별개의 방법으로 취급하겠습니다. 이것은 개략적인 개요에 불과하며, 많은 세부 내용은 생략합니다. 머신러닝에 대한 보다 완전한 개요는 [1-3]과 같은 자료를 참고해 주세요.

머신러닝의 유형

간단히 정의하자면, 머신러닝은 데이터의 패턴과 관계를 분석하고 추론을 도출하는 알고리즘의 집합입니다. 머신러닝 알고리즘은 크게 관련된 데이터의 유형과 알고리즘이 명시적으로 프로그래밍되지 않고 학습하는 방식에 따라 세 가지 주요 범주로 분류할 수 있습니다:

- 지도 학습: 지도 학습에서는 모델을 훈련하는 데 사용되는 데이터에 레이블이 붙어 있습니다. 이러한 알고리즘의 목표는 데이터와 해당 레이블 또는 출력 사이의 관계를 학습하고, 이를 보지 못한 데이터에도 일반화하는 것입니다. 이 범주의 일반적인 작업으로는 분류와 회귀가 있습니다.

- 비지도 학습: 지도 학습과 달리, 비지도 학습은 레이블이 없는 데이터를 사용하여 머신러닝 모델을 훈련합니다. 이러한 알고리즘의 목표는 데이터에서 숨겨진 패턴과 구조를 발견하는 것입니다. 이 범주에 속하는 알고리즘으로는 클러스터링과 차원 축소 알고리즘이 있습니다. 생성적 적대 신경망(GAN)과 변분 오토인코더와 같은 일부 생성 모델도 이 범주에 포함될 수 있습니다.

- 강화 학습: 이 머신러닝 범주의 알고리즘은 환경과 상호 작용하는 에이전트로 정의됩니다. 에이전트는 행동을 취하고 보상과 처벌의 형태로 환경으로부터 피드백을 받습니다. 이 피드백 메커니즘을 통해 에이전트는 결국 특정 작업을 수행하기 위한 올바른 행동 집합을 학습하게 됩니다.

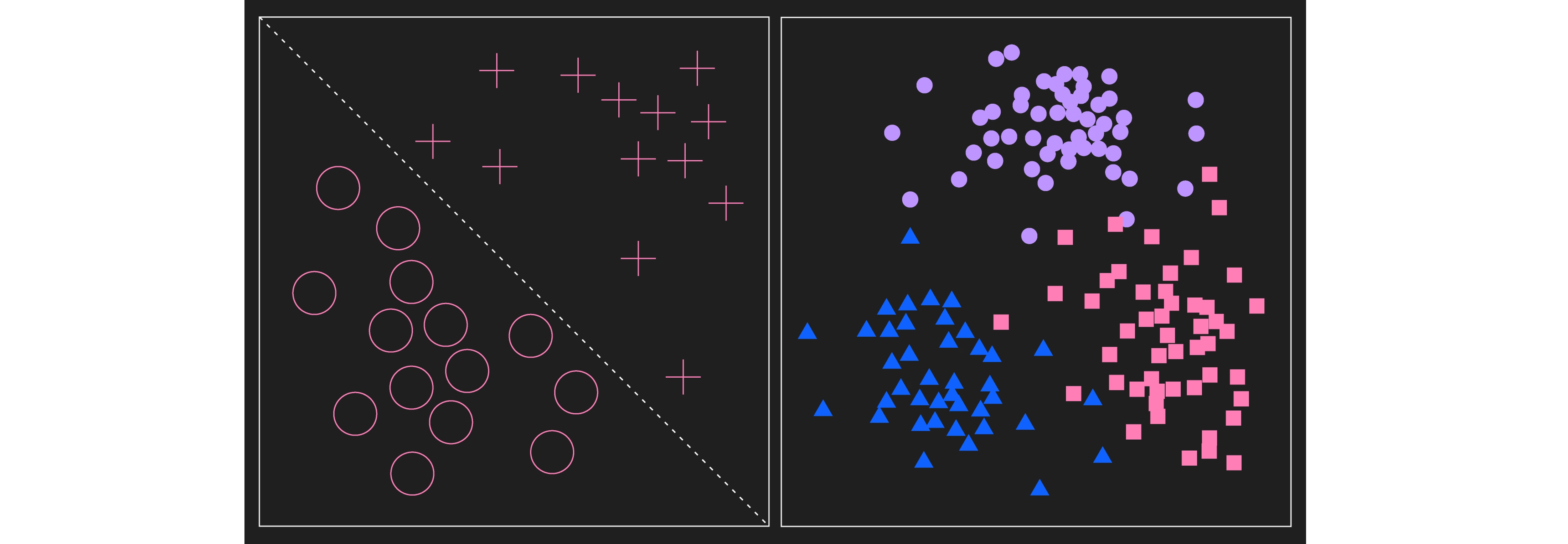

왼쪽 이미지는 지도 학습에서와 같이 레이블이 붙은 두 가지 데이터 범주를 보여줍니다. 이 경우, 두 범주는 선형으로 분리 가능합니다. 오른쪽 이미지는 데이터의 클러스터를 보여줍니다. 비지도 학습 작업에서는 이러한 데이터가 처음에는 레이블이 없으며, 알고리즘은 분포를 연구하면서 클러스터를 찾을 수도 있습니다. 알고리즘이 식별할 수 있는 클러스터의 예를 시각화하기 위해 데이터 포인트에 레이블이 붙어 있습니다. 두 방식의 주요 차이점은 지도 학습은 데이터에 이미 레이블이 붙어 있는 상태에서 시작하고, 비지도 학습은 마지막에 레이블이 붙더라도 레이블 없는 데이터로 시작한다는 점입니다.

머신러닝에 "양자" 도입하기

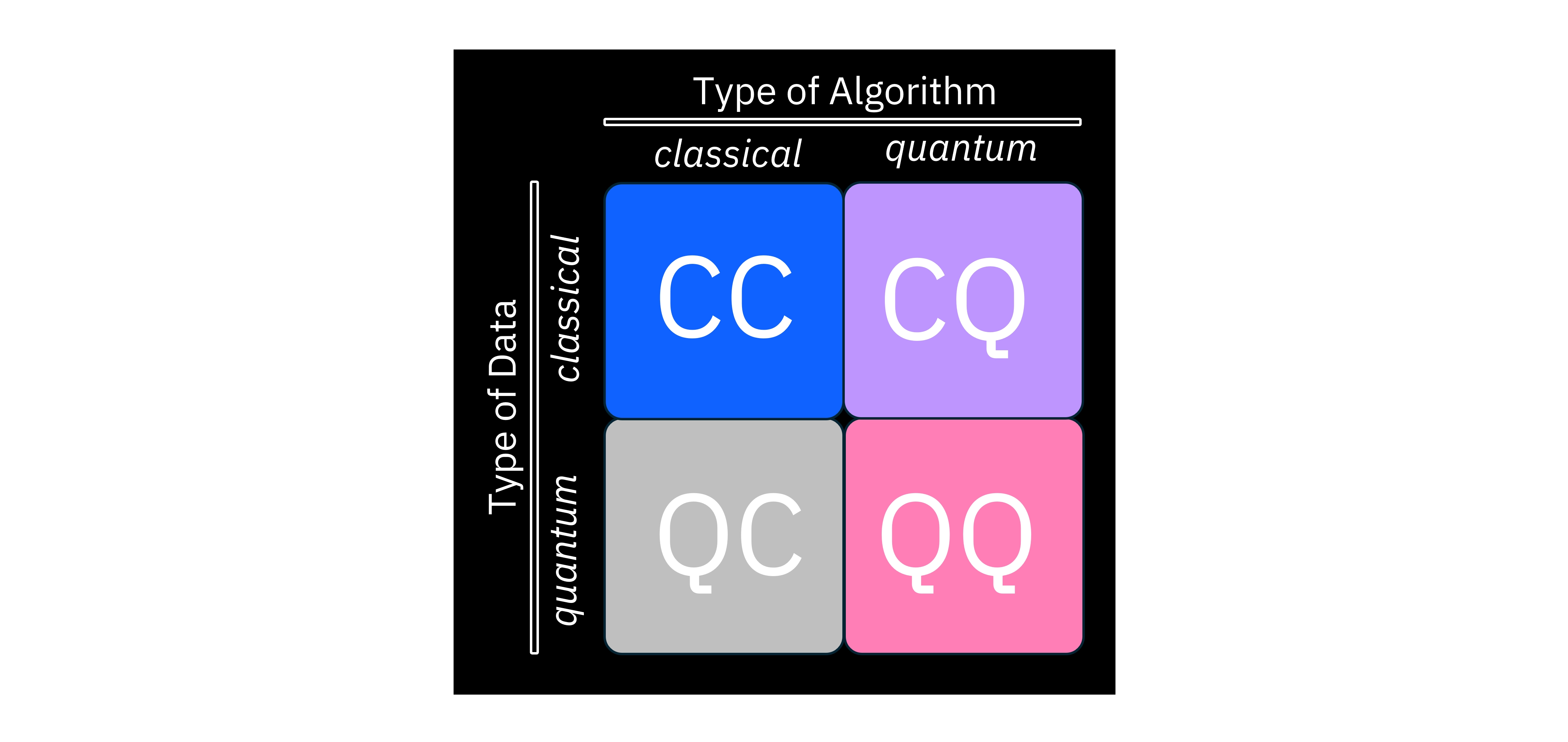

이제 머신러닝에 "양자"가 어떻게 도입되는지 탐구하기 시작할 수 있습니다. 이 더 넓은 분류에서는 처리 장치의 모델/알고리즘 유형과 제공되는 데이터의 유형을 고려합니다. 위의 그림은 이러한 가능한 조합들을 요약하고 있습니다.

예를 들어, CC는 고전 컴퓨터에 저장할 수 있는 이미지, 음성, 또는 텍스트와 같은 고전 데이터셋을 가지고 있으며, 머신러닝 알고리즘을 실행하기 위해 고전 컴퓨터도 사용한다는 것을 의미합니다. 이것이 바로 고전 머신러닝 환경입니다. 반면에 QQ는 양자 데이터를 처리하기 위해 양자 컴퓨터를 사용하고 있음을 의미합니다. 여기서 "양자 데이터"는 여러 가지를 의미할 수 있으며, 맥락에 따라 다를 수 있습니다. 양자 데이터는 양자 장치에서 얻은 측정 결과의 집합으로 생각할 수도 있고, 다른 알고리즘에 의해 양자 컴퓨터에서 준비된 상태를 가리킬 수도 있습니다. 미래에는 현재 존재하지 않는 QRAM(양자 랜덤 액세스 메모리)에 저장된 데이터를 가리킬 수도 있습니다. 연구자들이 양자 머신러닝에 대해 이야기할 때, 보통 데이터셋은 고전적이고 머신러닝 알고리즘을 실행하는 처리 장치는 양자 컴퓨터인 CQ 체제를 가리킵니다. 이 강의의 다음 부분에서는 그러한 알고리즘에 집중하겠습니다.

서포트 벡터 머신

이제 고전적인 머신 러닝 관점에서 서포트 벡터 머신(support vector machine)이라는 알고리즘 계열을 살펴보겠습니다. 이후에는 이 알고리즘에 양자 컴퓨팅을 어떻게 접목할 수 있는지 살펴봐요.

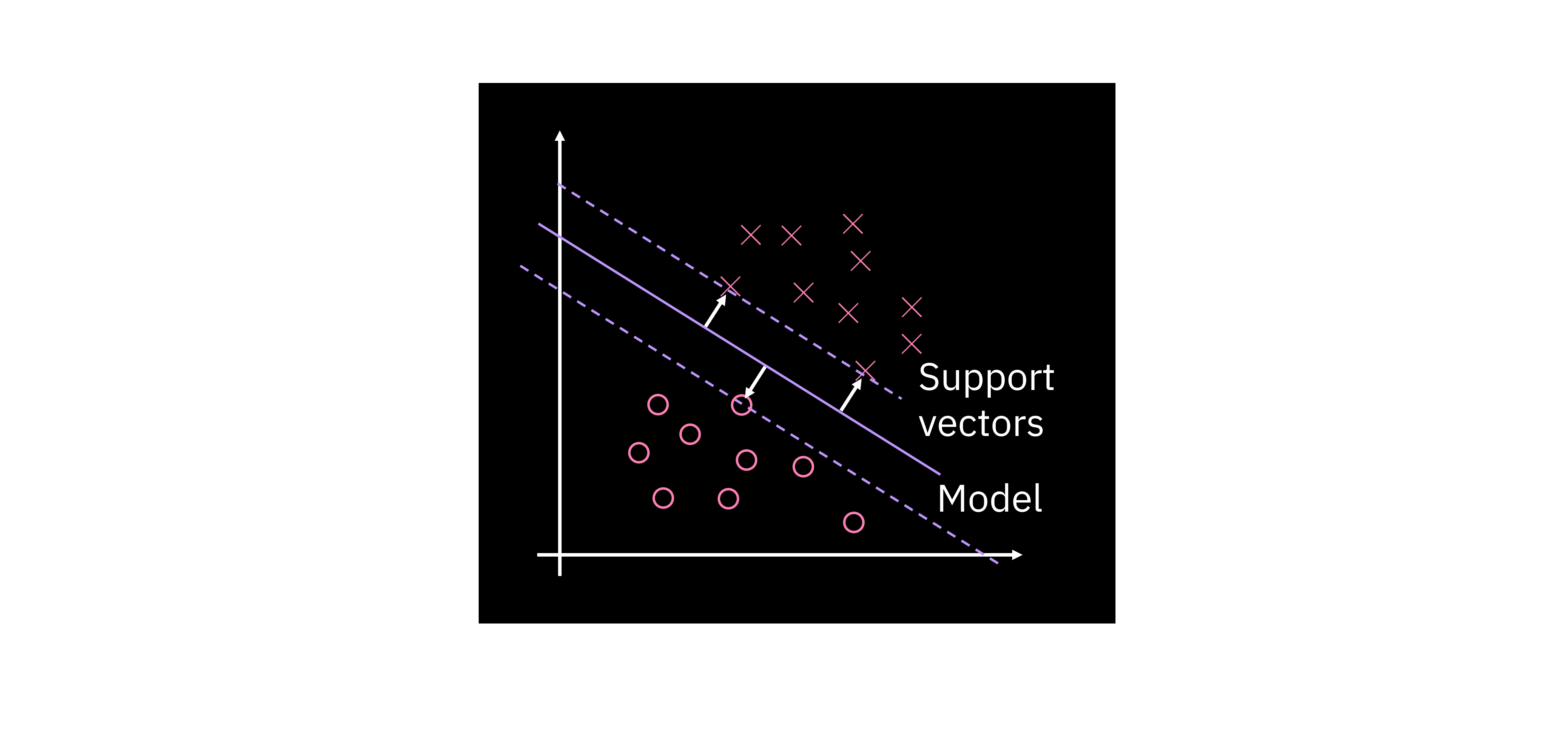

그림에 나온 것처럼 2차원 특성 공간을 가진 데이터셋에서 이진 분�류 작업을 수행한다고 가정해 봅시다. 이 데이터셋을 분류하는 한 가지 방법은 두 클래스를 분리하는 직선, 즉 일반적으로는 초평면(hyperplane)을 찾는 것입니다. 실제로는 무수히 많은 분리 초평면을 찾을 수 있으므로, 최적의 초평면을 어떻게 정의할지가 문제입니다. 여기서의 아이디어는, 특히 좋은 결정 경계(decision boundary)는 마진(margin)을 최대화해야 한다는 것입니다. 마진은 각 클래스에서 가장 가까운 점까지의 거리로 정의됩니다. 이 설정에서 결정 경계까지의 거리가 가장 짧은 데이터 포인트들을 서포트 벡터(support vector)라고 합니다.

선형 결정 경계는 여러 방식으로 표현할 수 있습니다. 가장 직관적인 방식 중 하나는 아래의 에 나타난 형태입니다. 여기서 는 초평면을 정의하는 파라미터 집합이고, 는 데이터셋이며, 는 상수 편향입니다. 는 입력 데이터 포인트의 공간에서 (반드시 그런 것은 아니지만) 주로 더 높은 차원의 공간으로의 사상(mapping)입니다. 이 사상에 대해서는 아래에서 다시 살펴보겠습니다.

모델 에서 는 모델이 학습할 조정 가능한 파라미터 벡터입니다. 이를 "원초 공식(primal formulation)"이라고 합니다. 수학적 조작을 거치면 동일한 문제를 두 번째 방식으로 공식화할 수 있습니다. 이를 "쌍대 공식(dual formulation)"이라 하며, 아래의 방정식 로 나타냅니다. 이 공식에서는 알파 파라미터를 최적화해야 합니다. 주요 차이점은, 원초 공식에서는 특성 벡터와 학습 가능한 파라미터 사이의 내적이 사용되는 반면, 쌍대 공식에서는 특성 벡터들 사이의 내적이 사용된다는 것입니다. 쌍대 공식에는 훈련 데이터의 특성과 해당 레이블이 모두 포함되지만, 다음 절에서 이것이 원초 공식보다 어떻게 더 유용한지 알게 될 것입니다.

커널 방법과 양자 컴퓨팅의 역할

아래 영상은 양자 컴퓨팅이 선형 분류기에서 어떤 역할을 할 수 있는지를 설명합니다. 이에 대한 자세한 내용은 본문에서 다룹니다.

고차원 공간으로의 이동

이 절과 다음 절에서는 고차원으로의 사상에 대한 논의가 중점적으로 이루어집니�다. 여기서의 핵심은 공간 간의 사상 맥락에서 "커널 트릭(kernel trick)"을 설명하고, 그를 통해 양자 커널이 무엇인지 이해하기 위한 토대를 마련하는 것입니다. 핵심은 양자 파동 함수의 고차원성이 모든 문제를 해결해 준다는 것이 아닙니다. 서론에서 언급했듯이, 고전적인 가우시안 특성 맵은 이미 무한 차원입니다. 데이터 특성의 차원성은 중요하지만, 고차원 양자 상태가 곧 고전적인 방법보다 나은 성능을 보장하지는 않습니다.

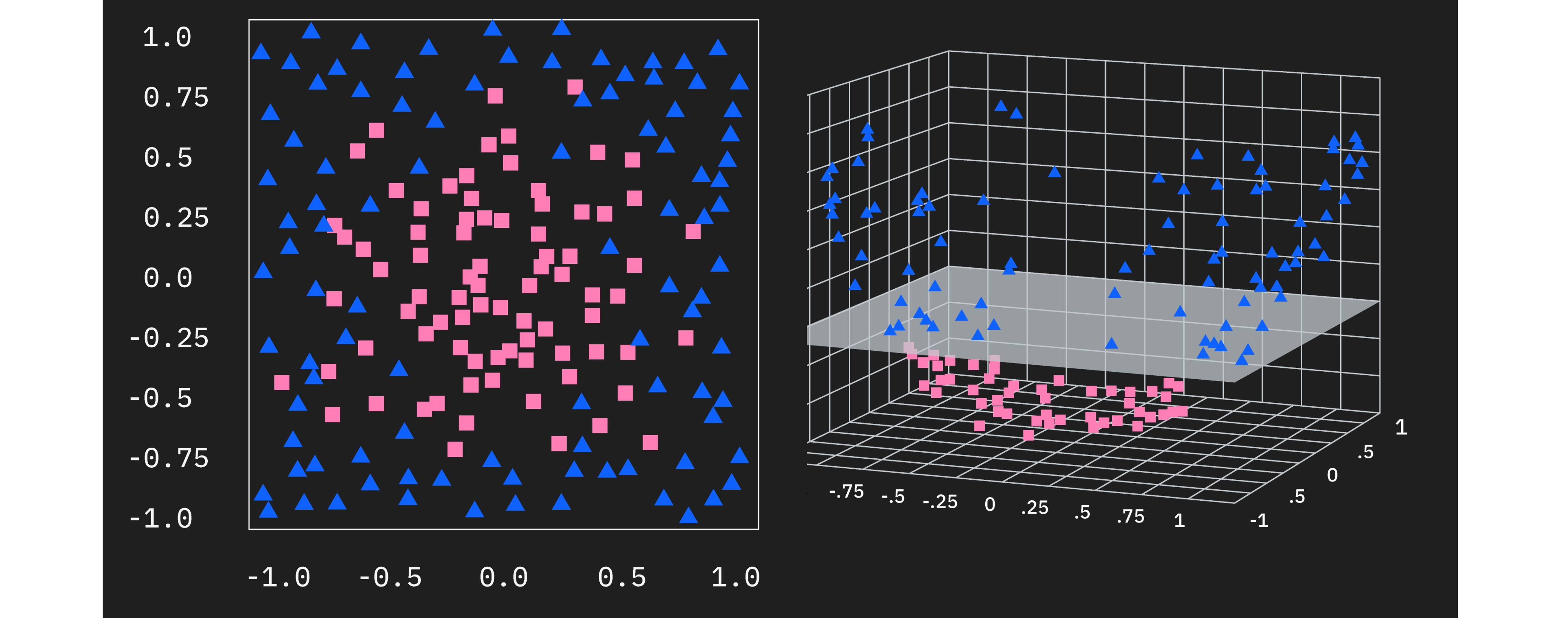

그래프로 보면, 올바른 고차원 사상만 있으면 SVM 접근 방식을 원래 데이터가 선형적으로 분리되지 않는 경우로 어떻게 일반화할 수 있는지 쉽게 알 수 있습니다. 왼쪽의 2차원 데이터를 보면, 두 클래스를 분리할 수 있는 선형 결정 경계가 없음을 알 수 있습니다. 그러나 특성 공간에 세 번째 특성을 추가하는 것을 고려할 수 있습니다. 예를 들어 이 새로운 특성이 이전 두 특성 과 의 원점으로부터의 거리라면, 데이터는 선형적으로 분리 가능해집니다. 이는 또한 이 고차원 특성 공간에서 서포트 벡터 머신 알고리즘을 성공적으로 실행할 수 있음을 의미합니다.

이 "특성 사상(feature mapping)"도 로 표기합니다. 특성 맵은 여기에 나타난 것처럼 대부분 입력 데이터 공간에서 더 높은 차원으로 사상되지만, 더 낮은 차원으로의 사상을 활용하는 모델과 알고리즘도 있습니다. 고차원으로의 사상은 시각화하고 이해하기 쉬운 사례일 뿐입니다.

일부 특성 맵은 매우 고차원의 공간으로 사상될 수 있습니다. 이러한 경우 고차원성으로 인해 내적 연산의 계산 비용이 높아집니다. 이 점에 대해서는 아래에서 다시 살펴보겠습니다.

쌍대 공식이 왜 유용한가?

선형 경계 모델의 원초 공식과 쌍대 공식을 다시 살펴봅시다.

이제 고차원 공간으로의 특성 맵을 사용하면 분리 초평면을 성공적으로 찾을 수 있음을 알았으므로, 방정식의 원래 특성 벡터 를 특성 사상된 벡터로 대체할 수 있습니다. 그러나 원초 공식에서 이를 수행하면, 파라미터와 잠재적으로 매우 고차원인 특성 맵 간의 내적을 계산해야 하는 문제가 발생합니다. 반면 쌍대 공식에서는 이것이 서로 다른 입력의 특성 사상된 벡터들 사이의 내적으로 대체됩니다.

일부 특성 맵의 경우, 특성 사상된 벡터의 내적 를 원래의 (저차원) 변수 와 의 간단한 함수 로 표현할 수 있습니다. 일부 선택에서는 를 저차원 내적 의 간단한 함수로 나타낼 수도 있습니다. 이는 계산적으로 매우 유익한데, 데이터가 선형적으로 분리되는 공간에 접근하면서�도 고차원 연산의 비용을 피할 수 있기 때문입니다. 실제로 특성 사상된 벡터는 에서 내적의 형태로만 나타나기 때문에, 내적을 계산하기 위해 특성 사상을 명시적으로 수행할 필요조차 없을 수 있습니다. 내적을 계산하는 함수 를 "커널 함수(kernel function)"라 하고, 특성 맵 계산을 이렇게 우회하는 방법을 "커널 트릭(kernel trick)"이라고 합니다. 실제로 특성 사상된 벡터가 무한 차원이더라도 커널은 여전히 매우 효율적으로 계산될 수 있습니다.

커널 함수 자체는 두 입력 데이터 벡터의 함수입니다. 데이터셋의 각 데이터 벡터 쌍을 커널 함수의 인수로 삽입하면 대칭적이고 양의 준정부호인 행렬, 즉 커널 행렬이 만들어집니다.

커널 행렬을 계산하고 나면, 이차 계획법(quadratic programming) 소프트웨어나 "순차 최소 최적화(sequential minimal optimization)"라는 알고리즘 등의 방법을 사용하여 최적의 파라미터()를 찾을 수 있습니다. 물론 이는 데이터 클래스를 선형적으로 분리할 수 있는 특성 맵에 해당하는 효율적으로 계산 가능한 커널이 존재한다는 전제 하에 성립합니다. 이와 관련하여 새로운 접근 방식이 바로 양자 커널 추정입니다.

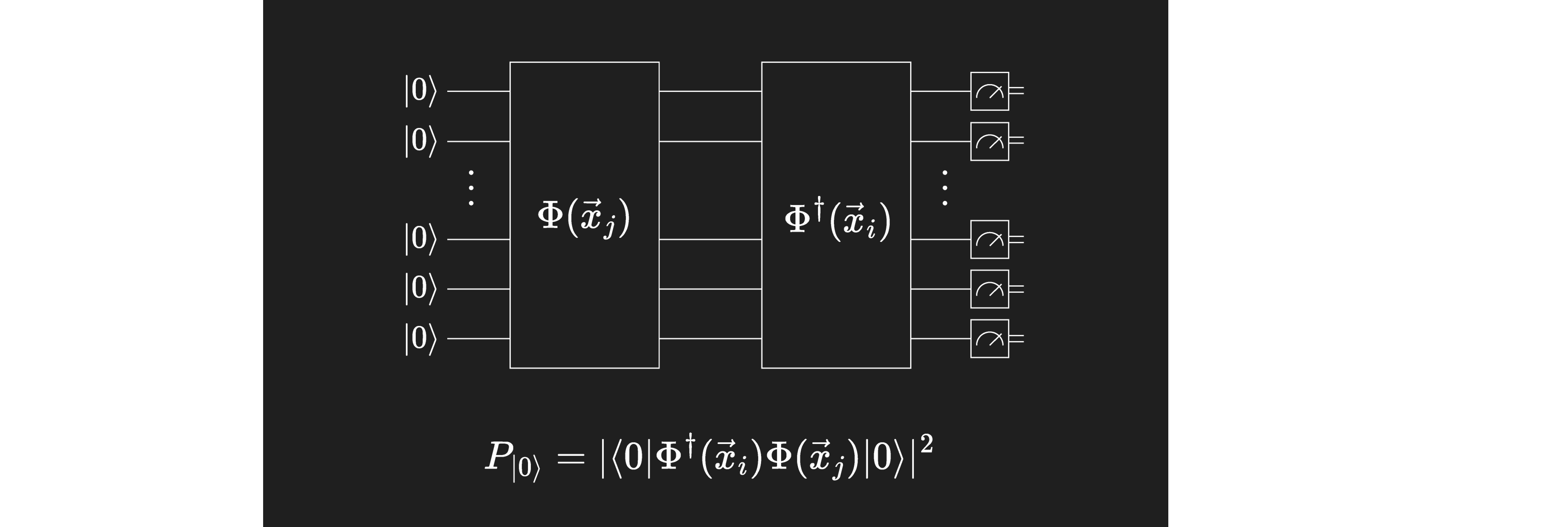

양자 커널

양자 컴퓨터, 또는 양자 상태 일반적으로 "양자 커널(quantum kernel)"을 매우 자연스럽게 정의할 수 있습니다. 입력 를 양자 상태 로 인코딩하는 과정을 특성 맵으로 해석할 수 있습니다. 이 과정은 고전적인 특성 맵에서 흔히 그렇듯 데이터를 매우 고차원의 공간으로 사상할 수 있지만, 차원수는 인코딩 방법에 따라 달라집니다(데이터 인코딩 강의를 참고하세요). 두 양자 상태의 내적 는 상태 에 있을 때 상태 를 측정할 확률과 관련이 있음을 기억하세요. 결과 Circuit에 대해 충분히 많은 측정을 수행함으로써 사상된 두 데이터 포인트 와 의 내적을 추정할 수 있습니다.

이후 강의에서 살펴보겠지만, 위와 같은 양자 Circuit의 측정을 활용하여 커널을 추정하고, 이후 커널 행렬에 대한 SVM 최적화를 고전적으로 실행하여 조정 가능한 파라미터를 학습할 수 있습니다.

변분 양자 분류기와 신경망

근단기 양자 머신러닝 알고리즘 중 하나로 "변분 양자 Circuit"(VQC)이 있습니다. 이 Circuit을 분류 작업에 활용할 경우, 동일한 약어가 "변분 양자 분류기(variational quantum classifiers)"를 가리키는 데 쓰이기도 합니다. VQC는 종종 고전 신경망(NN)과 유사한 구조를 활용하며, 이러한 경우 양자 신경망(QNN)으로 불리기도 합니다. VQC는 보다 일반적인 개념으로 반드시 신경망 구조를 따를 필요는 없지만, 양자가 기존 머신러닝 워크플로에서 어떤 역할을 하는지 명확히 이해하기 위해 먼저 신경망과의 유사점을 살펴봅니다. 이후 일반화된 내용을 논의합니다. 먼저 고전 신경망을 간략히 복습합니다.

아래 영상은 신경망을 간략히 소개하고, 변분 양자 Circuit과의 공통점을 설명합니다. 이 내용은 본문에서 더 자세히 다룹니다.

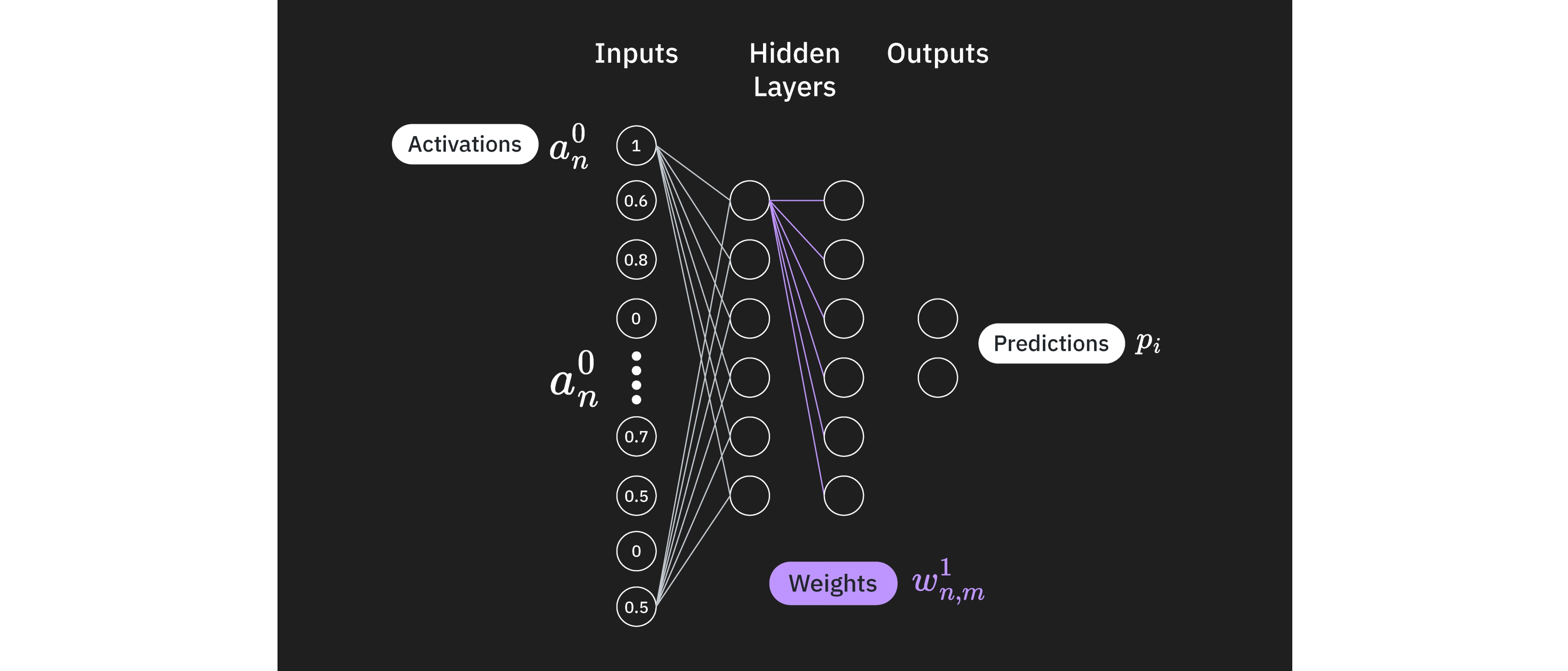

신경망은 뇌 속 뉴런의 구조와 기능에서 느슨하게 영감을 받은 계산 모델입니다. 그림에서 볼 수 있는 노드인 뉴런들은 층(layer)으로 구성되며, 가중치(weight)를 통해 서로 연결되어 있습니다.

첫 번째 층은 입력 층으로, 이 층의 뉴런 활성값 은 분석할 데이터 로부터 직접 전달됩니다(예를 들어 이미지의 개별 픽셀 밝기값 등). 마지막 ��층은 분류 결과를 나타내는 출력 층입니다(예를 들어 이미지가 개일 확률 90%, 고양이일 확률 10%로 분류하는 방식 등).

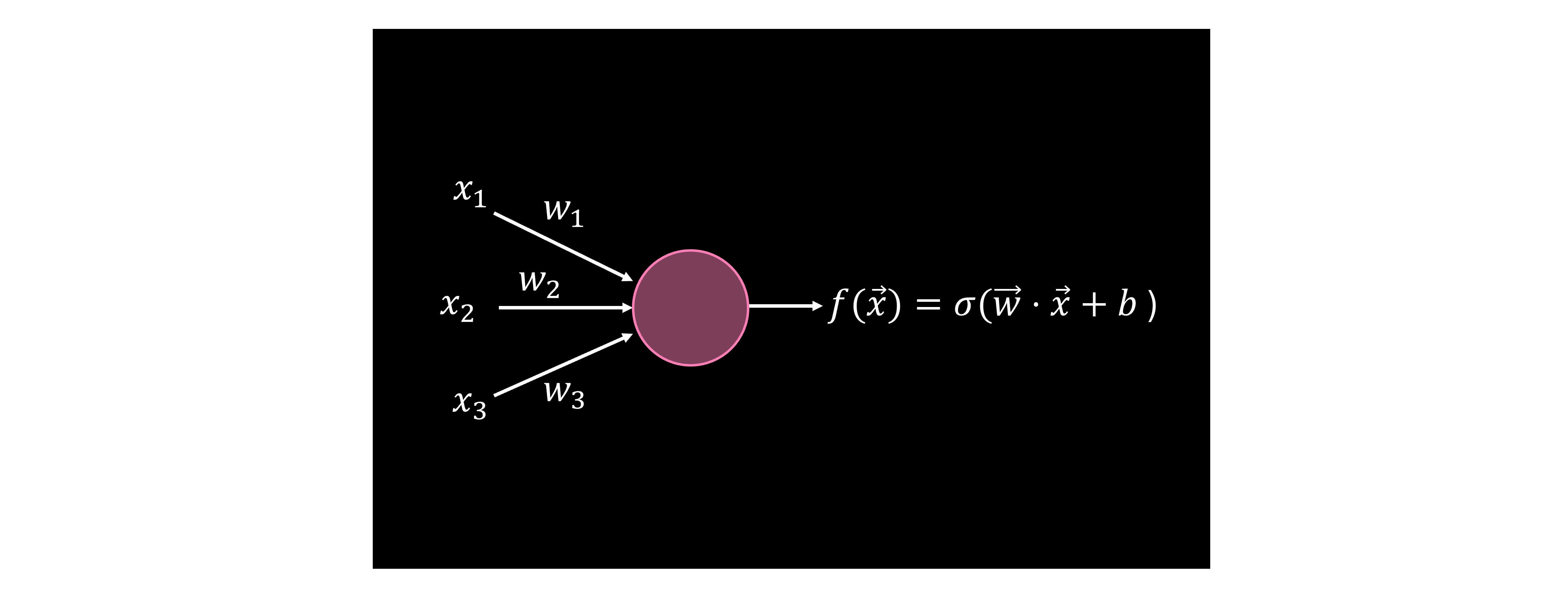

각 층의 뉴런은 이전 층으로부터 받은 신호를 처리하고, 가중치 (다이어그램의 연결선)를 통해 다음 층으로 전달합니다. 이러한 뉴런 하나를 살펴보면 신경망의 기본 구성 요소인 "퍼셉트론(perceptron)"을 얻을 수 있습니다. 수학적으로 퍼셉트론은 입력 벡터 를 받아 학습 가능한 가중치 벡터와의 내적에 편향(bias)을 더한 값을 계산합니다. 그리고 매우 중요하게도, 이 계산 결과에 비선형 활성화 함수()를 적용합니다. 이 비선형 활성화 함수는 신경망의 뛰어난 표현력에 필수적입니다. 다시 말해, 층과 층 사이에 비선형성이 없다면 전체 신경망을 하나의 큰 행렬 곱셈으로 표현할 수 있게 됩니다. 이 경우 단순한 선��형 모델이 되어 버려, 심층 신경망이 포착할 수 있는 복잡한 패턴을 학습하지 못하게 됩니다. 따라서 비선형 활성화 함수는 신경망의 핵심 요소입니다.

다음과 같은 함수가

알려진 데이터 와 비선형 함수 , 그리고 미지의 가중치 벡터 및 편향 를 이용하여 모든 뉴런에서 계산됩니다. 일반적으로 모든 층의 모든 뉴런 사이에 0이 아닌 가중치가 있을 수 있으며, 층 에서 층 로의 뉴런 과 사이의 가중치를 으로 표기합니다. 마찬가지로 번째 층의 번째 뉴런에 대한 편향은 으로 나타냅니다. 여기서의 편향은 앞의 양자 커널 논의에서 나온 와는 무관합니다.

신경망의 시작은 보통 임의의 가중치와 편향을 설정하거나, 합리적인 초기 설정에서 출발합니다. 그런 다음 신경망이 얼마나 잘 분류하는지 확인하고 개선해 나갑니다. 비용 함수(cost function)를 통해 신경망이 올바른 분류에서 얼마나 벗어났는지를 표현합니다. 비용 함수를 정의하는 방법은 다양합니다. 여기서는 평균 제곱 오차(MSE)를 사용하는 일반적인 예를 설명합니다.

응용 분야에 따라, 학습 데이터에서 이미지 의 출력 에 대한 실제 값 (예: "개" 출력 뉴런은 1.0, 나머지 뉴런은 0)와 예측 값 의 차이를 구합니다. 이 차이를 제곱하여 모든 카테고리에 대해 합산하면, 올바른 카테고리가 가장 높게 활성화되었는지뿐만 아니라 잘못된 활성화가 줄어들었는지도 함께 반영됩니다. 이를 학습 세트의 모든 예시에 대해 합산하면 비용이 됩니다.

그런 다음 각 층의 가중치와 모든 뉴런의 편향 등의 파라미터를 변화시킵니다. 경사 하강법(gradient descent)과 같은 고전 최적화 방법을 사용하여 비용 함수의 지역 최솟값을 찾습니다.

양자 퍼셉트론

퍼셉트론의 양자 대응물을 구축하려면, 고전 신경망의 활성화 함수 역할을 하는 비선형성을 양자 Circuit으로 구현하는 방법을 고려해야 합니다. 추가적인 처리 없이는 양자 Circuit이 단순히 선형 연산인 유니터리(unitary) 연산만 구현하기 때문입니다. 양자 Circuit에 비선형성을 도입하는 방법은 다양합니다. 주요 방법 중 하나는 측정(measurement)을 비선형성의 원천으로 활용하는 것입니다. 그 밖에도 양자 푸리에 변환 기반 방법, 회로 중간 측정(mid-circuit measurement) 또는 동적 Circuit, Qubit 부분 추적(tracing qubits out) 등의 방법이 있습니다.

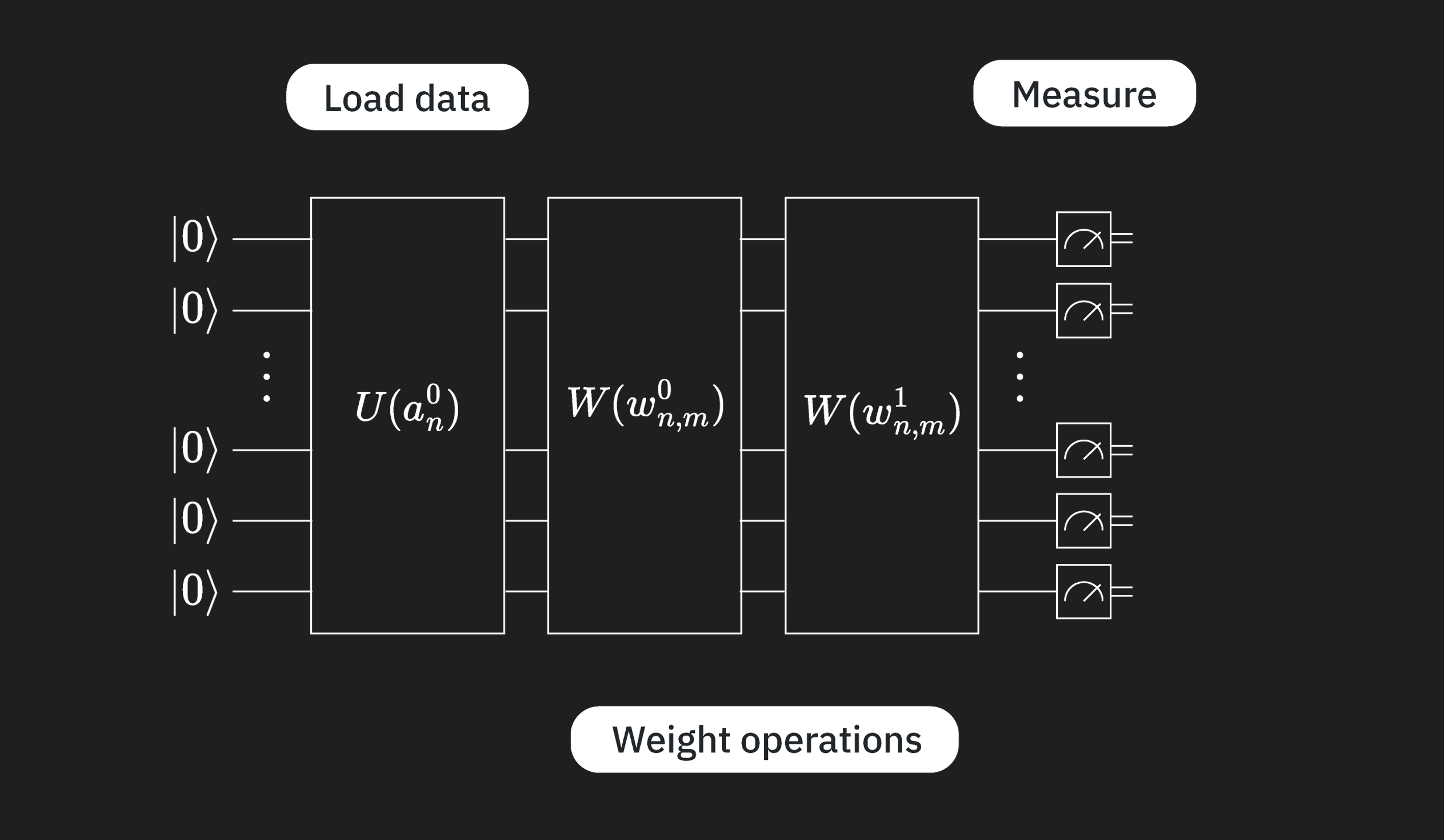

양자 신경망

양자 신경망(QNN)은 그림의 유니터리 층 로 입력 데이터를 인코딩한 뒤, 층 사이의 가중치에 해당하는 양자 Circuit()을 적용하고, 마지막으로 측정 층을 거쳐 동작합니다. 이에 대한 핵심 사항은 다음과 같습니다.

- 데이터 로딩과 가중치 적용은 선형 연산입니다.

- 측정은 비선형입니다.

- 따라서 고전 신경망과 마찬가지로 선형 및 비선형 구성 요소가 모두 포함됩니다.

- 가중치 Circuit에는 여전히 변분 파라미터가 있으므로, 고전적인 최소화 과정이 필요합니다.

위와 같은 Circuit을 사용하여 다음 함수를 계산할 수 있습니다. 이 함수는 일반적으로 고전 신경망에서 설명한 함수 와 동일하지 않습니다. 특히 이 함수는 여러 층에 걸친 다수의 가중치를 포함하며, 가 양자 Circuit에 로드한 모든 데이터에 적용됩니다.

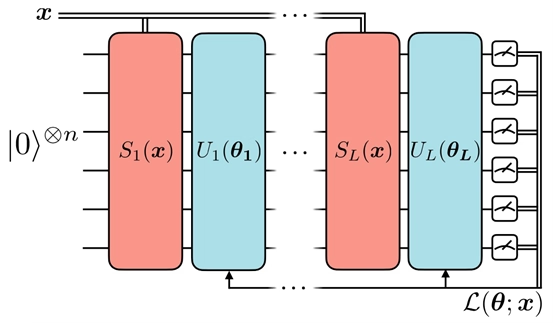

일반화

이제 신경망의 양자 대응물을 구성하는 방법 중 하나를 살펴볼 수 있습니다. 이 모델에서 정보의 흐름은 고전 피드포워드(feed-forward) 신경망과 다릅니다. 고전적인 설정에서는 정보가 입력에서 시작하여 출력으로 왼쪽에서 오른쪽으로 흐르고, 모델 학습 시 역전파(backpropagation)는 반대 방향으로 진행됩니다.

그러나 이 양자 신경망 구성에서는 데이터를 인코딩하는 유니터리 블록이 학습 가능한 파라미터를 가진 변분 유니터리 블록들 사이에서 반복됩니다. "데이터 재업로딩(data reuploading)"이라 불리는 이 전략은 흥미로운 이론적 결과에 의해 뒷받침됩니다. 실제로 Pérez-Salinas et al.의 논문에 따르면, 다중 데이터 재업로딩을 활용하면 "단일 Qubit이 고전 서브루틴의 도움을 받아 범용 양자 분류기를 구성하는 데 충분�한 계산 능력을 제공한다"는 것이 밝혀졌습니다. 따라서 데이터 재업로딩은 모델의 표현력과 표현 능력을 향상시켜 양자 신경망이 복잡한 함수를 근사할 수 있도록 하는 기법입니다.

참고문헌

[1] "Reinforcement Learning: An Introduction", Richard S. Sutton and Richard G. Barto, MIT Press, Second Edition, Cambridge, MA, 2018

[2] "Pattern Recognition and Machine Learning", Christopher M. Bishop, Springer, 2006

[3] "Foundations of Machine Learning", Mehryar Mohri, Afshin Rostamizadeh, and Ameet Talwalkar, MIT Press, Second Edition, 2018.